Resumen

Este proyecto presenta una tubería automatizada para el monitoreo de biodiversidad con cámaras trampa en Costa Rica, desarrollada a partir de registros obtenidos en el abrevadero del CEMEDE de la Universidad Nacional. El trabajo introduce el dataset cemede-redbioma-ct, un nuevo recurso con imágenes de especies locales, y compara dos estrategias de clasificación: una basada en MegaDetector como etapa previa de detección y recorte, seguida por el ajuste fino de modelos Vision Transformer, y otra basada en el ajuste fino de MegaDetector para clasificación directa.

Costa Rica alberga una proporción extraordinaria de la biodiversidad mundial, pero monitorear esa riqueza biológica sigue siendo costoso y laborioso cuando las imágenes deben revisarse manualmente. En este caso de estudio, las cámaras trampa se instalaron entre 2022 y 2024 en un fragmento de bosque tropical seco junto al Sendero El Cornizuelo, dentro del corredor biológico Bosques del Yaguarundí, para evaluar el aporte ecológico de un abrevadero construido como apoyo a la fauna local.

Las imágenes presentan retos reales de campo: lluvia, baja iluminación, escenas nocturnas, movimiento, resolución limitada y animales pequeños o parcialmente visibles. Estas condiciones, sumadas al fuerte desbalance entre clases, hacen que la clasificación automática de especies sea especialmente difícil y al mismo tiempo muy valiosa para acelerar el monitoreo de biodiversidad tropical.

cemede-redbioma-ct

Nuevo dataset abierto para monitoreo de biodiversidad tropical con cámaras trampa.

9,000+ videos procesados

29,498 imágenes generadas tras re-muestreo

11,674 imágenes finales en entrenamiento, validación y prueba

26 clases de especies

Disponible en Hugging Face.

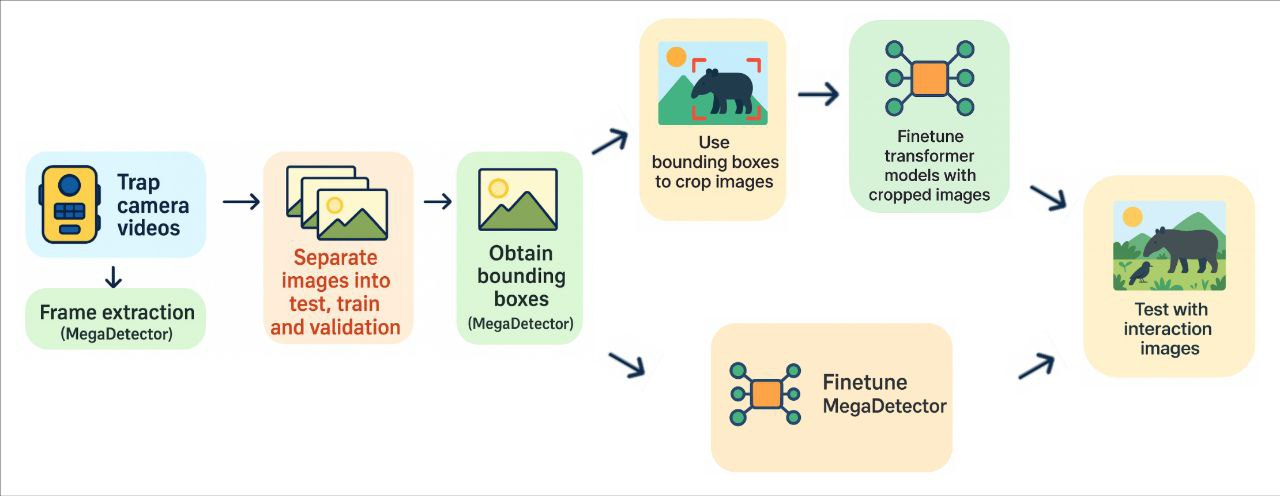

La metodología propuesta sigue dos ramas. En la primera, MegaDetector se utiliza para detectar animales y generar recortes de las regiones de interés; luego esos recortes alimentan tres clasificadores basados en transformers: DeiT, Swin y EfficientViT. En la segunda, MegaDetector se ajusta directamente para clasificar las especies a partir de las imágenes originales y sus anotaciones. Para evitar fuga de información, la división entre entrenamiento, validación y prueba se realizó a nivel de video.

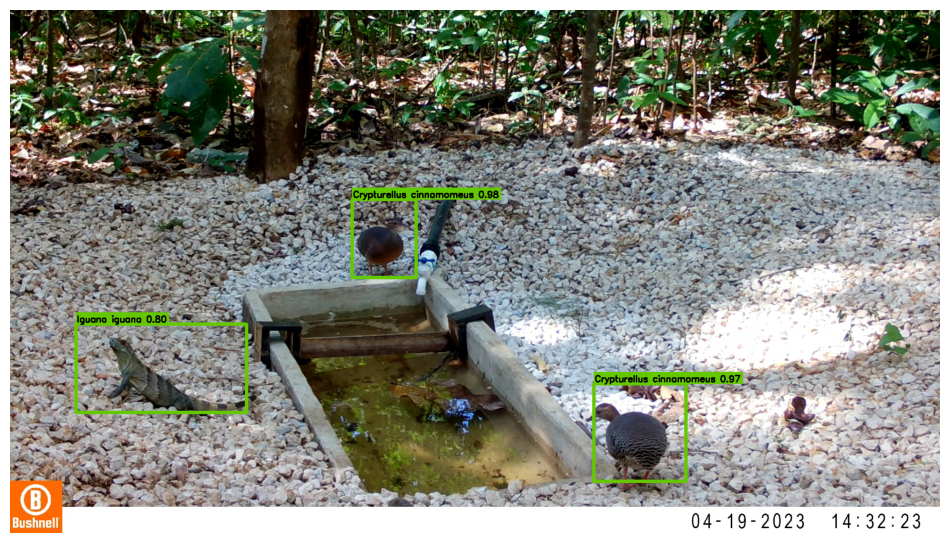

El estudio también evaluó la robustez de los modelos en escenas con múltiples animales, un escenario relevante para interpretar interacciones ecológicas. Además de clasificar especies, la tubería incorpora el conteo de individuos en imágenes con interacción, lo que amplía el valor ecológico de los resultados para monitoreo y conservación.

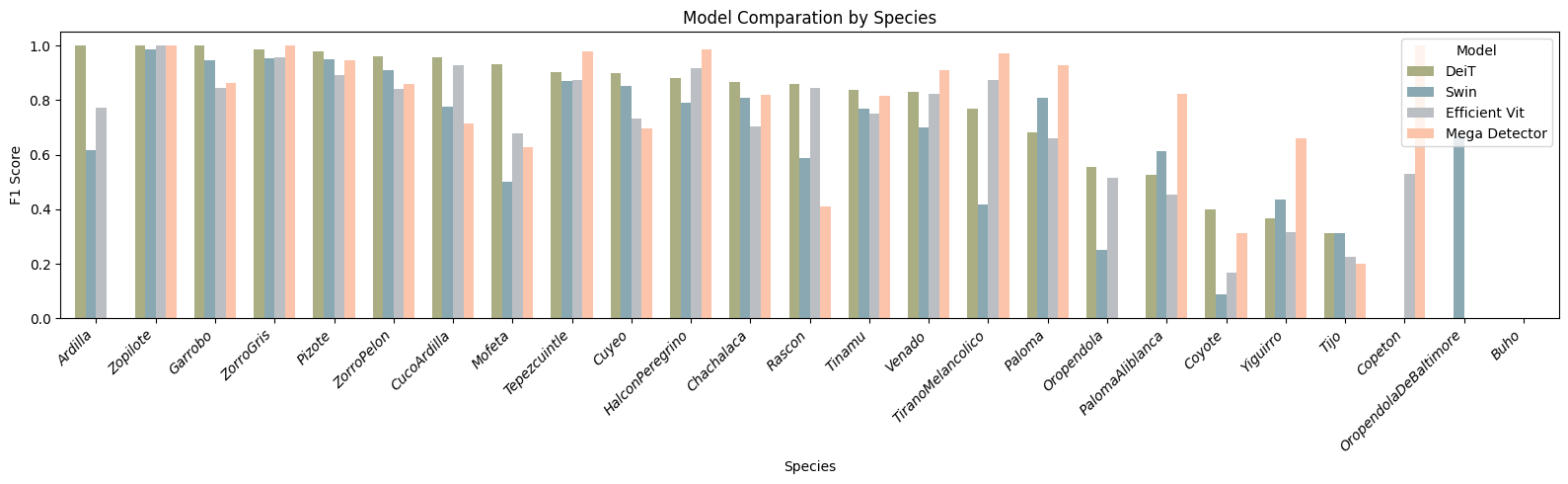

Los resultados muestran que DeiT obtuvo el mejor desempeño global, con 82% de accuracy, superando a Swin (76.2%), EfficientViT (74.1%) y MegaDetector ajustado para clasificación directa (75.1%). En imágenes con múltiples animales, DeiT también lideró con 0.8280 de accuracy, seguido por EfficientViT (0.7850), Swin (0.7742) y MegaDetector (0.7556). Estos resultados son competitivos frente a otros estudios reportados en el área, especialmente considerando las condiciones tropicales adversas y la complejidad del conjunto de datos.

El trabajo concluye que los Vision Transformers son una alternativa sólida para el monitoreo automatizado de biodiversidad en Costa Rica, aunque persisten retos importantes como el desbalance de clases, la escasez de ejemplos para especies raras y la baja calidad de parte de las capturas. Como trabajo futuro, el artículo propone explorar técnicas avanzadas de aumento de datos, aprendizaje semi-supervisado y extracción de comportamiento directamente desde video.

Más información está disponible en el dataset cemede-redbioma-ct.

Referencias

-

Biarreta-Portillo, M., Mora-Cross, M., Morataya-Sandoval, P., Salinas-Acosta, A., Víquez-Mora, E., López-Venegas, M., Gomez-Solís, W. & Bautista-Solís, P. (2025). Deep Learning Pipelines for Biodiversity Monitoring: MegaDetector and Vision Transformer Approaches with Camera Traps in Costa Rica.

-

Salinas-Acosta, A., Lopez-Venegas, M., Biarreta-Portillo, M., Morataya-Sandoval, P., Víquez-Mora, E., Mora-Cross, M., Gomez-Solís, W. & Bautista-Solís, P. (2025). redbioma/cemede-redbioma-ct. Hugging Face. https://huggingface.co/datasets/redbioma/cemede-redbioma-ct/.

-

Sánchez Brenes, R. J., Salinas Acosta, A. & López Venegas, M. F. (2025). Riqueza, abundancia y actividad de mamíferos silvestres captados en un abrevadero, sendero El Cornizuelo, Costa Rica. Revista Iberoamericana Ambiente & Sustentabilidad, 8, e474. https://doi.org/10.46380/rias.v8.e474.

-

Gadot, T., Istrate, Ș., Kim, H., Morris, D., Beery, S., Birch, T. & Ahumada, J. (2024). To crop or not to crop: Comparing whole-image and cropped classification on a large dataset of camera trap images. IET Computer Vision. https://doi.org/10.1049/cvi2.12318.

-

Kyathanahally, S. P., Hardeman, T., Reyes, M. et al. (2022). Ensembles of data-efficient vision transformers as a new paradigm for automated classification in ecology. Scientific Reports, 12, 18590. https://doi.org/10.1038/s41598-022-21910-0.